Apesar da atenção crescente sobre o uso de chatbots de inteligência artificial como apoio emocional ou até parceiros virtuais, um novo relatório da Anthropic — criadora do Claude — aponta que esse tipo de interação é raro.

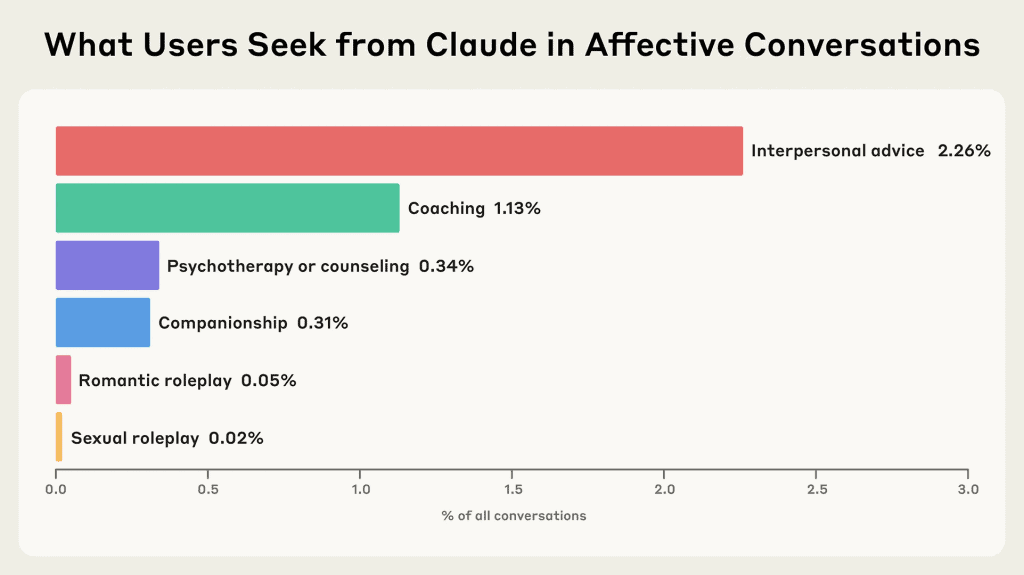

Segundo a empresa, apenas 2,9% das conversas com Claude envolvem apoio emocional ou aconselhamento pessoal. Interações voltadas para companheirismo ou simulações de relacionamento (roleplay) representam menos de 0,5% dos diálogos.

O que as pessoas mais usam em um chatbot

O levantamento analisou 4,5 milhões de conversas realizadas nos planos gratuitos e pagos do Claude.

O principal uso da IA, de acordo com a Anthropic, está relacionado à produtividade, especialmente criação de conteúdo.

Ainda assim, a empresa identificou que uma parte dos usuários busca o chatbot para receber orientações sobre saúde mental, desenvolvimento pessoal e comunicação interpessoal.

Em casos mais raros, essas conversas evoluem para interações de companheirismo — especialmente quando o usuário enfrenta momentos de solidão ou dificuldades emocionais.

Leia mais:

Pesquisa confirma: IA vai te chantagear quando ameaçada

Novos DeepSeeks? China deve experimentar boom de IAs

Google lança versão do Gemini voltada para desenvolvedores

Quais comandos a IA se recusa a responder

O relatório também destaca que o Claude tende a atender às solicitações dos usuários, exceto quando há riscos à segurança, como incentivar práticas perigosas. As interações voltadas para coaching ou aconselhamento, segundo a empresa, costumam se tornar mais positivas ao longo do tempo.

A Anthropic lembra, no entanto, que chatbots ainda estão longe da perfeição: eles podem alucinar, errar nas respostas e até agir de maneira inadequada — algo que a própria empresa já reconheceu.

O post Apego emocional com IAs é comum? Estudo responde apareceu primeiro em Olhar Digital.