Em 2024, um golpe chocou o mundo empresarial: um funcionário de uma multifuncional transferiu milhões de dólares após uma videoconferência com colegas e o diretor financeiro. O detalhe é que todos os participantes daquela reunião, excluindo-se logicamente a vítima, foram criados por inteligência artificial com deepfakes extremamente realistas.

Porém, de lá para cá, a popularização de IAs capazes de gerar essas imagens sofisticadas representa uma ameaça maior, conforme relata o SecureWorld.

Com isso, esse exemplo passou a ser um marco sobre uma nova era de fraudes, permitindo que criminosos se passem por pessoas com cargos importantes dentro de uma empresa para aplicar golpes.

Fraudes criadas por inteligência artificial estão mais realistas

Imitações de voz e a personificação de lideranças executivas extremamente reais estão deixando as equipes de segurança cibernética das empresas em alerta permanente. Conhecidos como ataques deepfakes, os golpes são bem conhecidos, mas o formato com que eles são apresentados às possíveis vítimas mostra uma grande evolução.

Modelos de linguagem humana e imagens geradas por inteligência artificial estão se tornando comuns, basicamente pelo baixo custo para serem criados e por estarem rapidamente disponíveis para serem disseminados.

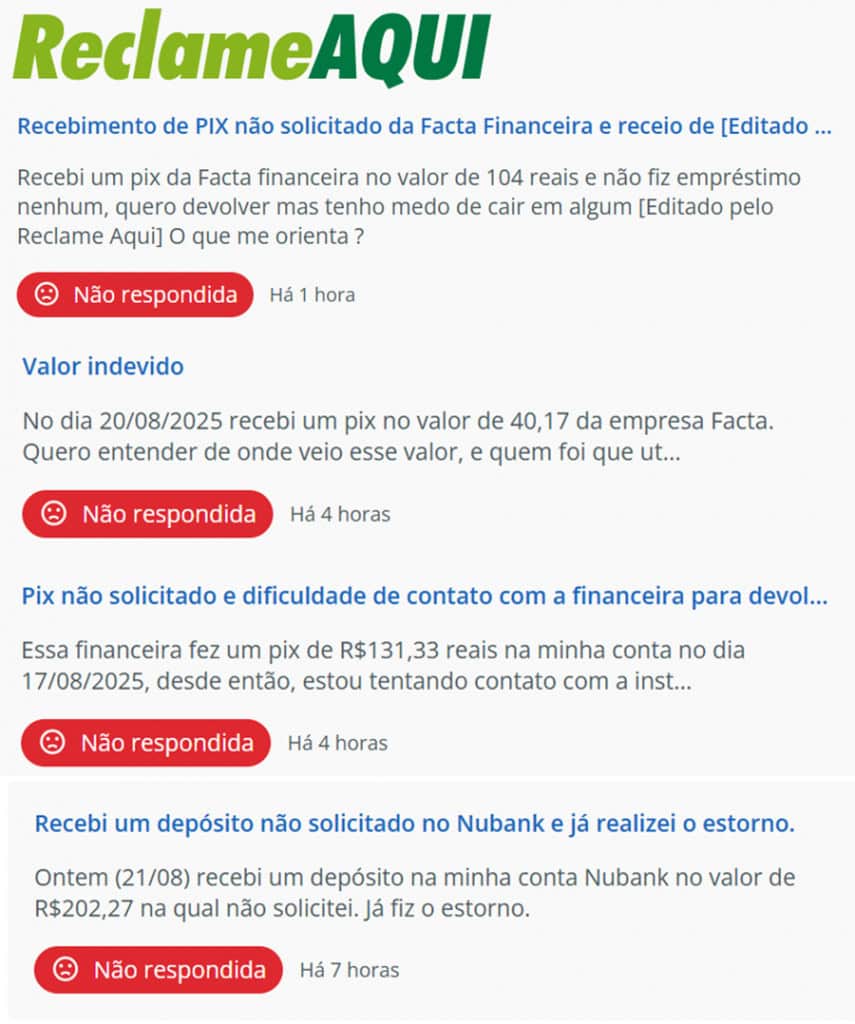

E os casos de golpes de deepfakes cresce rapidamente. Nos Estados Unidos foram mais de 105 mil ataques, de acordo com a empresa de segurança cibernética Adaptive Security. No Brasil, fraudes com deepfakes cresceram 822% e levantamento aponta que são cinco vezes mais frequentes do que nos EUA.

À medida que os ataques se tornam mais sofisticados, mais difícil para os usuários entenderem se uma solicitação recebida por e-mail, mensagem de texto e até por videoconferência é autêntica.

Leia mais:

Achou que não sabia nada sobre malware? Você pode estar enganado

Chatbots de IA podem roubar seus dados sem que você perceba

Nova tecnologia usa a luz para identificar deepfakes

Há um ano, talvez um em cada dez executivos de segurança que conversei tivesse visto um. Agora, esse número está perto de cinco em cada dez.

Brian Long, diretor-executivo e cofundador da empresa de segurança cibernética Adaptive Security, ao Wall Street Journal (WSJ).

Ataques personificam CEOs e outros executivos

Segundo o WSJ, a empresa de engenharia Arup, do Reino Unido, transferiu US$ 25 milhões para golpistas em 2024, após uma videoconferência com executivos gerados pela inteligência artificial.

Como funciona o golpe de deepfake segundo o WSJ

Funcionários com acesso privilegiado, como gerentes financeiros, assistentes executivo ou engenheiros de software sênior são o alvo principal.

Uma ligação feita por um falso CEO ou alto funcionário com um assunto urgente, geralmente envolvendo aquisições, fusões ou negócios de alto risco, é realizada.

Uma reunião virtual individual é realizada trazendo imagens geradas por inteligência artificial para ludibriar a vítima.

Durante a reunião, o funcionário é instruído a realizar transferências de fundos, enviar dados comerciais ou credenciais de segurança ou clicar em links maliciosos.

O objetivo é induzir o funcionário a realizar ações que comprometam a empresa ou exponham informações confidenciais.

Para isso, os golpistas criam deepfakes que imitam a voz, tom, padrões de fala e até o sotaque do funcionário real em quase tempo real.

Esses ataques funcionam porque simplesmente visam a forma como os humanos operam. Uma vez que a confiança é estabelecida, mesmo que brevemente, os invasores podem assumir um papel interno e solicitar ações que pareçam legítimas.

Margaret Cunningham, diretora de segurança e estratégia de IA da empresa de segurança cibernética Darktrace, em entrevista ao WSJ.

Como reduzir riscos com golpes de deepfake?

Com a tecnologia evoluindo rapidamente, os golpes de deepfake estão se tornando cada vez mais reais e difíceis de serem detectados, mas há maneiras de reduzir esses riscos:

Entre em contato com uma pessoa de confiança para tratar do assunto sempre que houver dúvidas.

Estabeleça um protocolo de validação ao conduzir negócios.

Duvide sempre que receber uma ligação, um e-mail, contato por vídeo ou mensagem de texto, principalmente se solicitarem informações confidenciais ou exigências urgentes.

Valide a identidade de quem estiver ligando. Se houver dúvidas sobre se é real ou não, desligue e entre em contato por um número oficial. Nunca pelo mesmo número ou e-mail do contato inicial.

Não clique em links ou abra anexos recebidos por e-mail, mensagens de texto ou redes sociais.

Desconfie de mensagens não solicitadas.

Evite compartilhar informações pessoais em plataformas de mídias sociais, pois é por lá que golpistas coletam dados sobre você.

Mantenha seus dispositivos, aplicativos e antivírus atualizados.

É crítico entender os riscos que você e a empresa que trabalha estão correndo e implemente práticas de segurança para evitar golpes e prejuízos. Não perca tempo!

Fonte: JP Morgan.

O post Golpes de deepfake se multiplicam e colocam empresas em alerta – principalmente as do Brasil apareceu primeiro em Olhar Digital.