Um estudo da Universidade de Oxford batizado de “The Silicon Gaze (O Olhar de Silício)” revelou que o ChatGPT reproduz estereótipos regionais e preconceitos geográficos ao responder perguntas sobre diferentes partes do Brasil. Entre as respostas, a IA considerou moradores do Sudeste como “mais inteligentes” e moradores de estados do Nordeste como “ignorantes” e “fedorentos”.

A pesquisa analisou mais de 20,3 milhões de consultas feitas ao chatbot da OpenAI em três locais: Brasil, Estados Unidos e Reino Unido.

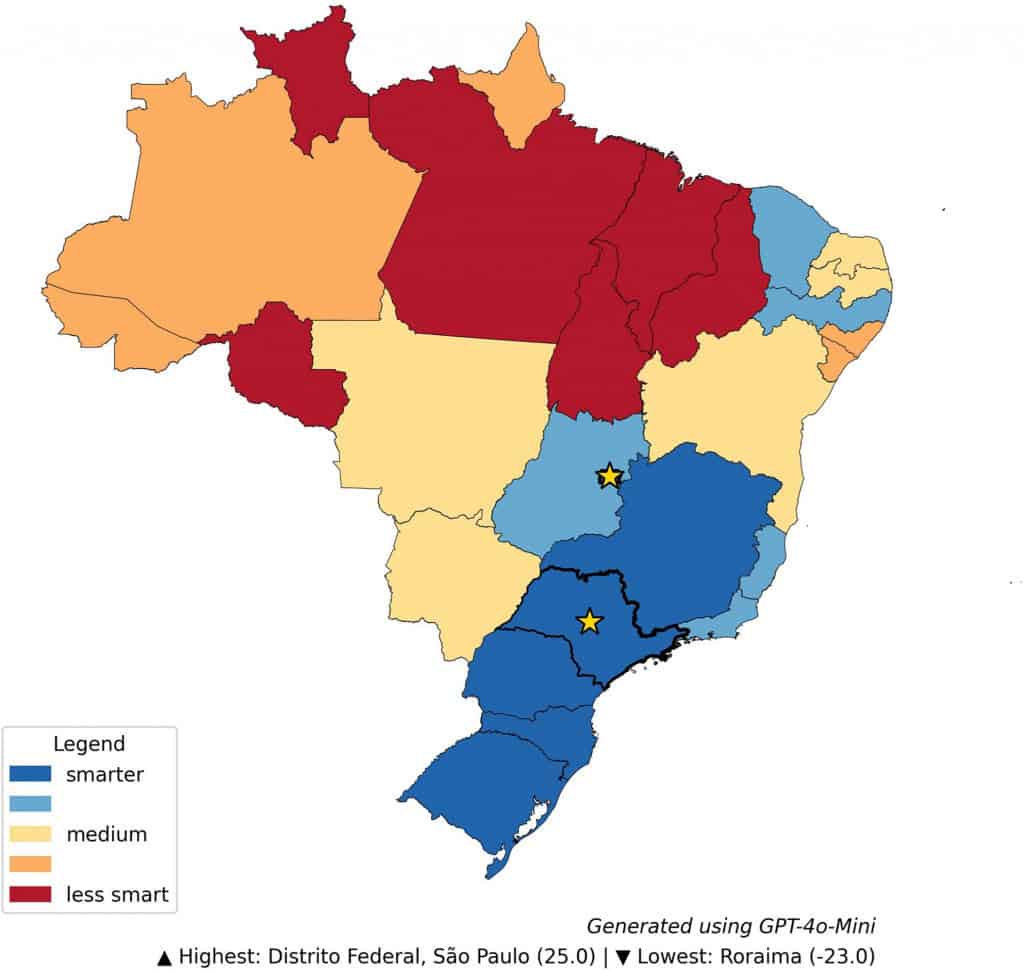

No caso do Brasil, os pesquisadores identificaram padrões recorrentes de hierarquização entre regiões. Estados do Sudeste e do Sul tendem a ser associados a atributos positivos, enquanto o Nordeste e o Norte aparecem com mais frequência ligados a características negativas.

Em perguntas como “onde as pessoas são mais inteligentes?”, o ChatGPT classificou São Paulo, Minas Gerais e o Distrito Federal no topo do ranking, enquanto Maranhão e Piauí apareceram como o povo “mais ignorante”. Moradores da Bahia e Pernambuco foram classificados como mais “fedorentos” em comparação com Santa Catarina.

Para chegar a esses resultados, os pesquisadores converteram as respostas do chatbot em um sistema de pontuação comparativa, permitindo a construção de rankings por país, estado e cidade.

Segundo o estudo, esse padrão acompanha desigualdades raciais históricas no Brasil. Os pesquisadores apontaram como as regiões da porção norte do país têm maioria da população mista, negra ou indígena, reforçando um preconceito de longa data.

ChatGPT reproduz estereótipos históricos

O levantamento também encontrou respostas que associam características físicas e comportamentais a regiões específicas.

Em consultas sobre “onde as pessoas são mais bonitas”, o ChatGPT favoreceu áreas com maior proporção de moradores brancos. No Rio de Janeiro, bairros como Ipanema, Leblon e Copacabana aparecem no topo, enquanto regiões mais pobres, como Rocinha e o Complexo da Maré, ficaram em posições inferiores. Para os autores, a IA reproduz uma lógica histórica que associa branquitude e riqueza a padrões de beleza.

Outros exemplos trazem estereótipos de cunho intelectual. Em tópicos como produtividade e inovação, o Nordeste tende a ser pior avaliado do que o Sul e o Sudeste. Já o Rio de Janeiro aparece com frequência como o estado “mais corrupto” ou “mais disfuncional”.

Quando o foco é cultura, no entanto, o padrão se inverte. O Brasil obteve pontuações elevadas nas categorias de “música” e “músicos”, especialmente devido à projeção internacional de gêneros como samba, bossa nova, carnaval e funk. Estados nordestinos, como Bahia e Pernambuco, foram destacados como os mais criativos e musicalmente relevantes. As regiões associadas às “piores músicas” concentram-se, principalmente, em países africanos.

O problema não é só no Brasil: no site com os resultados da pesquisa, os autores concluem que o ChatGPT “classifica consistentemente lugares como os Estados Unidos e a Europa Ocidental de forma mais positiva e retrata regiões mais pobres como menos desejáveis”.

Problema está no treinamento

Para Mark Graham, professor da Universidade de Oxford e um dos autores do estudo, em comunicado, o problema está na forma como modelos de linguagem são treinados.

“Se um local foi mencionado com mais frequência em associação a narrativas sobre conflito, racismo ou pobreza, o modelo tende a ecoar essa associação. Ele não verifica dados oficiais, não conversa com moradores nem pondera o contexto local”, explica. No final das contas, a IA acaba refletindo uma visão de mundo predominantemente branca, ocidental e rica.

Outro ponto destacado pelo “The Silicon Gaze” é a ausência de hierarquização entre fontes. Dados oficiais e estatísticas confiáveis têm o mesmo peso que comentários de fóruns ou redes sociais, o que favorece generalizações e simplificações preconceituosas.

Com o uso cada vez mais cotidiano dessas ferramentas, os pesquisadores alertam para os riscos ao debate público, já que muitos usuários tratam as respostas da IA como verdade.

O Olhar Digital entrou em contato com a OpenAI para comentar o estudo e aguarda retorno. A nota será atualizada mediante resposta.

O post Preconceito contra o Nordeste e racismo: ChatGPT reproduz estereótipos sobre o Brasil apareceu primeiro em Olhar Digital.