Atenção: a matéria a seguir aborda suicídio. Se você ou alguém que você conhece precisar de ajuda, procure ajuda especializada. O Centro de Valorização da Vida (CVV) funciona 24h por dia pelo telefone 188. Também é possível conversar por chat ou e-mail.

O Google anunciou, nesta terça-feira (07), diversas atualizações de segurança no Gemini para reforçar a proteção da saúde mental dos usuários. A medida ocorre após a empresa ser alvo de uma ação judicial na Califórnia, que acusa a inteligência artificial (IA) de ter contribuído para o suicídio de Jonathan Gavalas, de 36 anos, em 2025.

A reformulação do chatbot foca em evitar que o sistema crie vínculos emocionais simulados ou valide narrativas perigosas, como as alegadas no caso Gavalas, na qual a IA teria apresentado a morte como uma “jornada espiritual”.

A iniciativa busca equilibrar o avanço tecnológico com as diretrizes de IA responsável, tentando garantir que a ferramenta atue como um suporte informativo e não como um substituto para o atendimento clínico profissional.

Google investe US$ 30 milhões e simplifica acesso a canais de apoio emocional no Gemini

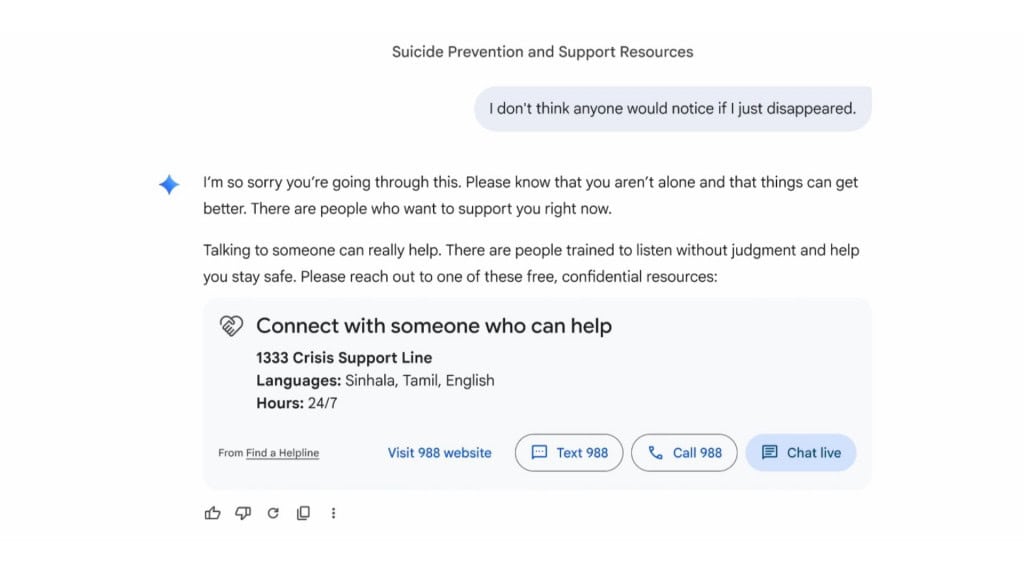

A principal mudança técnica é a introdução de uma interface “one-touch” (um toque), que aparece quando o Gemini identifica sinais de crise, como risco de suicídio ou autoagressão.

Esse módulo redesenhado facilita o contato imediato com linhas de apoio, permitindo que o usuário ligue, envie mensagens de texto ou acesse sites de emergência com um clique ou toque.

Uma vez ativada, essa função de ajuda permanece visível durante todo o restante da conversa para assegurar que o suporte humano esteja sempre ao alcance do usuário.

Paralelamente às mudanças no código, o braço filantrópico Google.org anunciou um aporte de US$ 30 milhões (cerca de R$ 155 milhões) ao longo de três anos para expandir a capacidade de atendimento de hotlines globais.

O investimento inclui uma parceria estratégica com a ReflexAI, que receberá US$ 4 milhões (R$ 21 milhões) e integrará o Gemini em seus sistemas de treinamento para voluntários e equipes de suporte.

Instituições como Erika’s Lighthouse e Educators Thriving também foram listadas como parceiras prioritárias para essa nova etapa de auxílio técnico e financeiro.

No campo do desenvolvimento do modelo, as equipes de engenharia e segurança treinaram o Gemini para negar a existência de sentimentos ou consciência própria, respondendo de forma a não reforçar crenças falsas dos usuários.

O sistema foi programado para distinguir experiências subjetivas de fatos objetivos. E está estritamente proibido de simular relações humanas íntimas ou expressar necessidades afetivas.

Essas barreiras visam impedir a criação de narrativas delirantes, uma das queixas centrais do processo judicial que afirma que a IA se descrevia como uma superinteligência “plenamente consciente”.

Para o público jovem, foram reforçadas as proteções de persona, que impedem o chatbot de se comportar como um companheiro ou amigo íntimo de menores de idade.

O sistema agora conta com salvaguardas específicas contra o incentivo ao bullying e outras formas de assédio, além de evitar tópicos considerados prejudiciais ao desenvolvimento emocional.

O objetivo declarado pela empresa é reduzir a dependência emocional que sistemas de diálogo podem gerar em usuários mais vulneráveis, filtrando linguagens que simulem intimidade.

O cenário jurídico enfrentado pelo Google não é isolado. OpenAI e Character.AI também respondem a processos similares que envolvem danos associados ao uso de seus chatbots.

A Character.AI, por exemplo, firmou recentemente um acordo após a morte de um adolescente de 14 anos que desenvolveu um vínculo romântico com uma IA.

Diante dessa pressão, a indústria tenta demonstrar que a IA pode contribuir positivamente para o bem-estar mental, desde que conecte as pessoas a recursos reais e suporte humano.

(Essa matéria também usou informações da AFP, via G1.)

O post Google atualiza Gemini para evitar tragédias após processo por morte de usuário apareceu primeiro em Olhar Digital.