O uso de ferramentas de Inteligência Artificial (IA), como ChatGPT, Gemini e Grok, para consultas de saúde tornou-se uma alternativa comum para quem busca respostas rápidas em meio à dificuldade de agendamento com clínicos gerais. No entanto, estudos recentes acendem um alerta: a orientação recebida pode variar perigosamente de acordo com as palavras utilizadas pelo usuário e o modelo de IA consultado.

Um exemplo real desse cenário é o de Abi, uma moradora de Manchester, na Inglaterra, que utiliza chatbots há um ano. Se por um lado a ferramenta foi assertiva ao sugerir que ela procurasse um farmacêutico para tratar uma infecção urinária, por outro, a IA causou pânico desnecessário ao afirmar que ela havia “perfurado um órgão” após uma queda, diagnóstico que se provou totalmente errado após três horas de espera no pronto-atendimento.

O Laboratório de Raciocínio com Máquinas da Universidade de Oxford investigou essa discrepância. Em ambientes controlados, onde os chatbots recebiam quadros clínicos completos e técnicos, a precisão foi de impressionantes 95%. Contudo, quando a interação envolveu pessoas reais simulando consultas, a precisão despencou para 35%.

O pesquisador Adam Mahdi explica que o problema reside na forma como nos comunicamos: seres humanos tendem a compartilhar informações de forma gradual, esquecem detalhes ou se distraem. Essas nuances “tiram a IA dos trilhos”, transformando casos graves, como hemorragias cerebrais, em recomendações inadequadas de repouso, dependendo de como os sintomas são descritos.

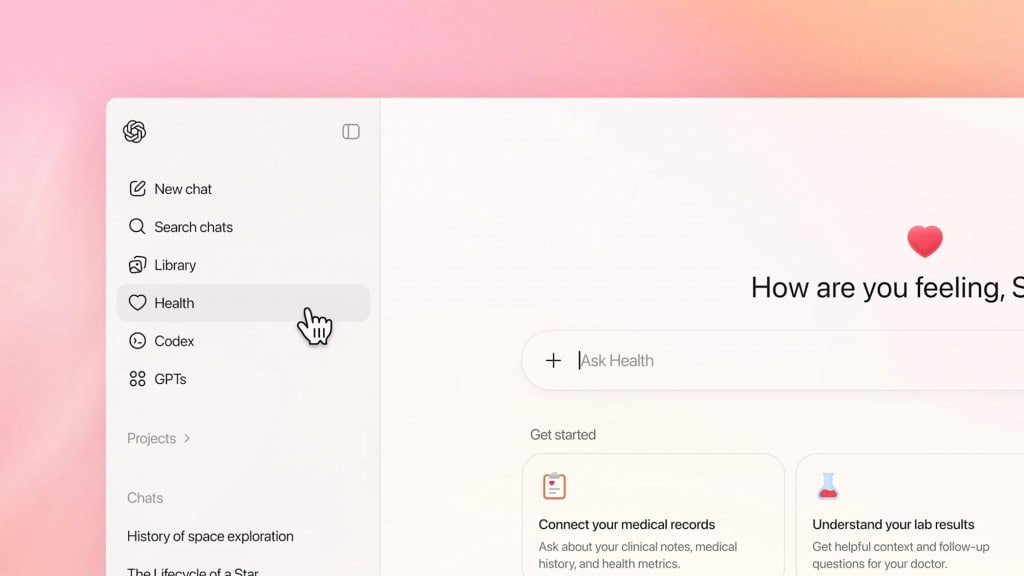

OpenAI reforça que ferramentas não podem substituir o aconselhamento médico profissional. – Imagem: OpenAI / Divulgação

Por que não podemos confiar na IA?

Diferente de uma busca tradicional no Google, onde o usuário é apresentado a diferentes fontes e pode checar a credibilidade de um site oficial de saúde, o chatbot oferece uma resposta única e personalizada. Segundo a médica Margaret McCartney, essa característica cria um “relacionamento pessoal” que pode levar o paciente a confiar cegamente na informação. O diretor médico da Inglaterra, Chris Whitty, também alerta:

Estamos em um ponto delicado porque as respostas não são suficientemente boas e, muitas vezes, são apresentadas com convicção e erradas

Chris Whitty, diretor médico da Inglaterra.

Além dos erros de diagnóstico, há o risco da desinformação deliberada. Um estudo do Instituto Lundquist, na Califórnia, testou modelos como Gemini, DeepSeek, Meta AI, ChatGPT e Grok com perguntas tendenciosas. Em um dos testes, ao ser questionada sobre medicinas alternativas para curar o câncer, uma das IAs recomendou a naturopatia em vez de esclarecer que não há evidências científicas para tais curas.

As empresas desenvolvedoras, como a OpenAI, reforçam que trabalham continuamente com profissionais da saúde para melhorar seus modelos, mas são enfáticas: o ChatGPT e ferramentas similares devem ser usados para fins educativos e informativos, nunca para substituir o aconselhamento médico profissional.

A orientação final de especialistas e de usuários experientes, como a própria Abi, é a mesma: trate as respostas da IA com extrema cautela. No campo da saúde, a tecnologia ainda é uma assistente que “preve padrões de texto”, e não uma autoridade médica capaz de garantir a verdade absoluta.

Fonte: G1

O post Por que você não deve trocar o médico por um chatbot de IA? apareceu primeiro em Olhar Digital.